Rozkład prawdopodobieństwa

Rozkład prawdopodobieństwa – miara probabilistyczna określona na zbiorze wartości pewnej zmiennej losowej (wektora losowego), przypisująca prawdopodobieństwa wartościom tej zmiennej[1]. Formalnie rozkład prawdopodobieństwa można rozpatrywać bez odwołania się do zmiennych losowych.

Definicja formalna

Rozkład prawdopodobieństwa – to miara probabilistyczna określona na σ-ciele podzbiorów borelowskich pewnej przestrzeni polskiej Dla rozkładów ciągłych jako przestrzeń polską wybiera się:

- zbiór liczb rzeczywistych (dla 1-wymiarowej zmiennej losowej),

- przestrzeń euklidesowa (dla n-wymiarowej zmiennej losowej).

Rozkład prawdopodobieństwa nazywamy jednowymiarowym, jeżeli zmienna losowa jest 1-wymiarowa, a wielowymiarowym, jeżeli zmienna losowa jest n-wymiarowa.

Zastosowanie zmiennych losowych

Przestrzenią probabilistyczną nazywa się trójkę uporządkowaną, złożoną z: a) przestrzeni zdarzeń elementarnych b) określonego na niej σ-ciała którego elementy są nazywane zdarzeniami losowymi, c) miary probabilistycznej przyporządkowującej zdarzeniom liczby zwane prawdopodobieństwami.

Tak określone prawdopodobieństwo jest jednak niewygodne do badania, gdy jest zbiorem bez zadanych jakichkolwiek relacji między jego elementami. Dlatego definiuje się funkcję zwaną zmienną losową, która przyporządkowuje elementom przestrzeni elementy jakiejś przestrzeni mierzalnej o pożądanych właściwościach[a]. Najczęściej jako przestrzeń mierzalną wykorzystuje się przestrzeń euklidesową, tj. Wtedy zmienną losową nazywa się wektorem losowym.

Przeciwobraz każdego zbioru mierzalnego w jest zdarzeniem losowym. Podzbiory mierzalne przestrzeni tworzą σ-ciało, które oznaczać będziemy symbolem Ponieważ zmienna losowa nie musi być funkcją różnowartościową, więc ten sam zbiór mierzalny można w ogólnym przypadku otrzymać z wielu różnych zdarzeń o różnych prawdopodobieństwach. Aksjomaty σ-ciała zapewniają, że wśród tych zdarzeń jest także ich suma i do niej jest przypisane największe prawdopodobieństwo. Suma ta jest równa przeciwobrazowi zbioru czyli

Rozkład zmiennej losowej – to funkcja określona na sigma ciele taka że prawdopodobieństwo zdarzenia jest równe prawdopodobieństwu przypisanemu przeciwobrazowi zdarzenia

Rozkład jest nową miarą probabilistyczną. Jest on w przestrzeni stanów odpowiednikiem miary probabilistycznej

Uwaga 1:

Zapis gdzie jest zdarzeniem, a nie zmienną losową jest stosowany na oznaczenie prawdopodobieństwa warunkowego.

Uwaga 2:

Niżej omówiono rozkłady ciągłe i dyskretne. Oprócz nich istnieją także rozkłady nie mieszczące się w żadnej z tych kategorii – na przykład rozkład o dystrybuancie Cantora.

Rozkład ciągły

Jeżeli istnieje funkcja taka że

(całka Lebesgue’a) dla dowolnego zbioru borelowskiego to funkcję tę nazywa się gęstością rozkładu prawdopodobieństwa (funkcją gęstości prawdopodobieństwa).

Nazwa pochodzi od intuicji fizycznych (zob. gęstość masy). O rozkładzie mającym gęstość mówi się, że jest ciągły (lub typu ciągłego).

Powyższa definicja jest poprawna dla dowolnych rozkładów prawdopodobieństwa, także wielowymiarowych – wówczas jest wektorem.

Rozkład zmiennej losowej spełniający powyższe warunki definiuje się analogicznie. O zmiennej losowej również mówi się wówczas, iż jest ciągła (lub typu ciągłego).

Rozkład dyskretny

Rozkład nazywa się dyskretnym, jeśli jest skupiony na zbiorze przeliczalnym, tzn. istnieje zbiór (co najwyżej) przeliczalny dla którego Jeżeli

- oraz dla każdego

to dla dowolnego zbioru borelowskiego

gdzie to indykator (funkcja charakterystyczna) zbioru

Zatem zbiór par jednoznacznie wyznacza rozkład Stąd dowolny zbiór tej postaci, gdzie oraz (co wynika z własności rozkładu), nazywa się czasami rozkładem (dyskretnym). Odwzorowanie oznaczane nosi nazwę funkcji masy prawdopodobieństwa i jest ono dyskretnym odpowiednikiem gęstości prawdopodobieństwa.

Dyskretna zmienna losowa to zmienna losowa o rozkładzie dyskretnym. Wówczas można go zdefiniować podobnie jak wyżej równością

jednakże w tym wypadku zachodzi dodatkowo

gdzie jest zbiorem wszystkich wartości przyjmowanych przez zmienną

Dystrybuanta rozkładu jednowymiarowego

Osobny artykuł: dystrybuanta.

Osobny artykuł: dystrybuanta.

Dystrybuantą jednowymiarowego rozkładu prawdopodobieństwa nazywa się funkcję zdefiniowana wzorem:

Dystrybuanta rozkładu zmiennej losowej to dystrybuanta oznaczana zwykle symbolem otrzymana z rozkładu tej zmiennej losowej:

Jeśli rozkład ma gęstość jego dystrubuanta wyraża się wzorem:

Dystrybuanta w pełni wyznacza rozkład, tzn. dwie zmienne o tej samej dystrybuancie muszą mieć ten sam rozkład; obrazuje to poniższy przykład.

Przykłady

1) Niech będzie przestrzenią zdarzeń elementarnych doświadczenia polegającego na rzucie monetą, które może z jednakowym prawdopodobieństwem dać dwa wyniki: orła i reszkę, tj.

- oraz

Jeżeli zmienna jest określona równościami

- oraz

to jej rozkład jest określony następująco:

a funkcja masy prawdopodobieństwa ma postać:

Oznacza to, że zmienna losowa odwzorowuje zdarzenia

oraz zachowuje prawdopodobieństwo określone na przekształcając je w rozkład określony na

Z definicji dystrybuanty wynika, iż prawdopodobieństwo zdarzenia

dane jest wzorem

Dystrybuanta zmiennej to funkcja określona wzorem

2) Niech będzie przestrzenią zdarzeń elementarnych rzutu monetą, wyżej opisanego, przy czym dodatkowo uwzględnimy upadek na kant, który prawie na pewno się nie zdarzy. Jeżeli

- oraz

to zmienna losowa określona równościami

- oraz

ma taki sam rozkład (oraz funkcję masy) co zmienna określona wyżej, mimo iż są one różne.

Także dystrybuanta zmiennej dana jest tym samym wzorem co dystrybuanta zmiennej

Dystrybuanta rozkładu wielowymiarowego

Osobny artykuł: dystrybuanta.

Osobny artykuł: dystrybuanta.

Jeśli jest wektorem losowym, tzn. to rozważa się wówczas przedziały wielowymiarowe, tzn. zbiory będące iloczynami kartezjańskimi przedziałów, mające postać

Dystrybuanta ma postać

Stosuje się następujący zapis dystrybuanty rozkładu zmiennej losowej:

gdzie

Oznaczając powyższy wzór można zapisać w skrócie

Jeśli rozkład wielowymiarowy ma gęstość jego dystrybuanta wyraża się za pomocą całki Lebesgue’a:

co można zapisać w prostszej wersji (ale tylko wtedy, gdy całkę Lebesgue’a da się rozbić w poniższy sposób):

Rozkład osobliwy

Df. Zmienna losowa ma rozkład osobliwy (singularny), jeśli ma ciągłą dystrybuantę oraz istnieje zbiór taki że ma on zerową miarę Lebesgue’a i jednostkowy rozkład prawdopodobieństwa tzn.

- oraz

Rozkład arytmetyczny

Df. Rozkładami arytmetycznymi nazywa się rozkłady skoncentrowane na zbiorze punktów postaci gdzie

Tw. To, iż rozkład jest skupiony na zbiorze jest równoważne temu, iż jego funkcja charakterystyczna ma okres równy bądź dla pewnego

Analizując funkcje charakterystyczne można stwierdzić, że arytmetyczne są rozkłady:

geometryczny, Bernoulliego i Poissona.

Rozkłady jedno- i dwupunktowe są przesuniętymi rozkładami arytmetycznymi.

Popularne rozkłady

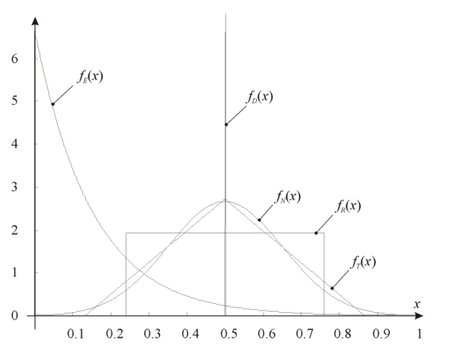

Rozkłady ciągłe

– rozkład normalny,

– rozkład wykładniczy,

– rozkład jednostajny,

– rozkład trójkątny,

– rozkład delty Diraca dla zmiennej pewnej.

Osobny artykuł: ciągły rozkład prawdopodobieństwa.

Osobny artykuł: ciągły rozkład prawdopodobieństwa.

- rozkład beta,

- rozkład χ²,

- rozkład Cauchy’ego,

- rozkład chi,

- rozkład Erlanga,

- rozkład F Snedecora,

- rozkład gamma,

- Rozkład Fishera-Tippetta,

- rozkład Weibulla,

- rozkład jednostajny ciągły (prostokątny),

- rozkład Laplace’a,

- rozkład Leviego,

- rozkład logarytmicznie normalny,

- rozkład normalny (Gaussa),

- wielowymiarowy rozkład normalny,

- rozkład trójkątny,

- rozkład Studenta,

- rozkład wykładniczy.

Rozkłady dyskretne

Osobny artykuł: dyskretny rozkład prawdopodobieństwa.

Osobny artykuł: dyskretny rozkład prawdopodobieństwa.

- rozkład Boltzmanna,

- rozkład dwupunktowy (Bernoulliego u anglojęzycznych autorów),

- rozkład dwumianowy (Bernoulliego u większości polskich autorów),

- rozkład jednopunktowy (typu delta Diraca),

- rozkład jednostajny dyskretny,

- rozkład geometryczny,

- rozkład hipergeometryczny,

- rozkład Poissona,

- rozkład zero-jedynkowy,

- rozkład ujemny dwumianowy (Pascala).

Pozostałe

Statystyka

Jeśli mamy na myśli rzeczywiste prawdopodobieństwa wystąpienia danej wartości cechy w populacji, to mówimy o rozkładzie w populacji. Jeśli mamy na myśli prawdopodobieństwa wystąpienia danej cechy wyznaczone podczas badania statystycznego, to mówimy o rozkładzie empirycznym.

Zobacz też

| Zobacz galerię związaną z tematem: Rozkład prawdopodobieństwa |

Uwagi

- ↑ Ściślej musi to być funkcja -mierzalna, gdzie jest rodziną podzbiorów borelowskich przestrzeni Jako zwykle wybiera się jedną z tzw. przestrzeni polskich, do których zaliczają się w szczególności przestrzenie euklidesowe.

Przypisy

- ↑ Rozkład zmiennej losowej, [w:] Encyklopedia PWN [dostęp 2021-07-22] .

- p

- d

- e

| Rozkłady ciągłe | |

|---|---|

| Rozkłady dyskretne |

- PWN: 3969261

- SNL: fordeling_-_statistikk

![{\displaystyle F_{P}(t)=P((-\infty ,t]).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ede92bdf596eaafe39f0a1c79e50cfdb30f8a7ab)

![{\displaystyle F_{X}\colon \mathbb {R} \to [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2c8b1f920efed0f59b86d229e8dac70c85df3ed0)

![{\displaystyle (-\infty ,t_{1}]\times (-\infty ,t_{2}]\times \ldots \times (-\infty ,t_{n}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/90a76b1b1efffd852f108900f2be5a1f3710d18a)

![{\displaystyle F_{P}(t_{1},t_{2},\dots ,t_{n})=P((-\infty ,t_{1}]\times (-\infty ,t_{2}]\times \ldots \times (-\infty ,t_{n}]).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1d37ce5aceec3849d08806075eed62012182180e)

![{\displaystyle F_{P}(t)\qquad \,=\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\int \limits _{(-\infty ,t_{1}]\times (-\infty ,t_{2}]\times \ldots \times (-\infty ,t_{n}]}\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!\!f(t)dt,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a07f01553d92c998af73051a05a938ba0b68d7ad)